基于原型學習與深度特征融合的腦功能連接分類方法研究

梁玉澤 冀俊忠 ,

人類大腦是一個高度復雜的系統(tǒng),通過腦區(qū)之間的互相協(xié)作來完成特定任務.這種協(xié)作方式可以通過定量地分析靜息態(tài)功能磁共振成像(Restingstate functional magnetic resonance imaging,rsfMRI)數(shù)據(jù)來表達,該表達稱為功能連接.已有研究表明,精神障礙疾病與患者腦區(qū)之間功能連接的異常改變密切相關(guān)[1].因此,對腦功能連接分類的研究有助于揭示腦疾病的致病原因,具有十分重要的現(xiàn)實意義.

目前腦功能連接分類方法主要分為兩種:基于傳統(tǒng)機器學習的分類方法和基于深度學習的分類方法.基于傳統(tǒng)機器學習的分類方法使用淺層模型分析腦功能連接,其中支持向量機(Support vector machine,SVM)[2-3]和套索算法(Least absolute shrinkage and selection operator,LASSO)是兩種最常用的算法.雖然傳統(tǒng)的機器學習方法已經(jīng)表現(xiàn)出較好的分類效果,但是受限于淺層結(jié)構(gòu),特征表達能力不足,分類準確率有待進一步提升.與傳統(tǒng)機器學習方法相比,深度學習方法具有更強的特征提取能力,能夠系統(tǒng)地從腦功能連接中提取從低層次到高層次的特征.其中,棧式自編碼器(Stacked autoencoders,SAE)結(jié)構(gòu)簡單,能夠逐層提取數(shù)據(jù)中深層次的特征,是腦功能連接分類任務中最常用的深度學習方法之一[4-5].此外,有研究將卷積神經(jīng)網(wǎng)絡(Convolutional neural network,CNN)應用于腦功能連接分類任務,針對腦功能連接的特點設計了多種網(wǎng)絡結(jié)構(gòu),取得了不錯的效果[6-7].不過,基于深度學習的腦功能連接分類準確率仍存在進一步的提升空間.

近年來,有研究發(fā)現(xiàn),在分類時綜合利用深度模型提取的不同層次的特征,相比于僅使用最高層次的特征能夠提升分類效果.Sun 等[8]使用CNN來提取人臉特征,將其用于人臉分類任務.該方法將CNN 中最后一個池化層與全連接層提取的特征拼接起來,作為最終的特征表示,在分類時充分考慮了不同層次特征中的信息,與一些代表性的方法相比具有較高的分類準確率.張婷等[9]在傳統(tǒng)CNN的基礎(chǔ)上引入了跨層連接思想,將CNN 中第二個池化層的特征跨越模型中間的隱層直接與全連接層連接起來,最后使用該特征來預測樣本類別.該方法可以有效地將高層次特征和低層次特征結(jié)合起來,在人臉性別分類任務中獲得了比傳統(tǒng)CNN更高的準確率.李勇等[10]針對LeNet-5 在表情識別中識別率不高的問題提出了一種基于跨連接LeNet-5 網(wǎng)絡的面部表情識別方法,該方法能夠?qū)⑸窠?jīng)網(wǎng)絡提取的低層次特征和高層次特征融合,提高了表情識別率.最近,又有研究表明,將原型學習與深度學習結(jié)合能夠提取到類內(nèi)差異小,類間差異大的鑒別性特征.Yang 等[11]將原型學習與CNN 結(jié)合,提出了卷積原型學習,該模型能夠顯著縮小CNN 提取到的特征的類內(nèi)差異,提高了CNN 的魯棒性.Wang 等[12]提出了一種基于原型學習的原型集成方法,該方法不僅能夠縮小深度特征的類內(nèi)差異,而且能夠擴大類間差異,從而提高了增量學習中新類別的檢測的魯棒性.Zhang 等[13]提出了模態(tài)缺失情況下的深度編碼及分類模型(Cross partial multiview networks,CPM-Nets),該模型充分利用完備信息編碼和原型分類思想,提高了模態(tài)缺失情況下多模態(tài)數(shù)據(jù)的分類性能.可見,將原型學習與深度學習結(jié)合用于腦功能連接分類任務,并且在分類階段綜合利用深度模型提取到的不同層次的特征,將有望在獲得與疾病相關(guān)的鑒別性特征的同時進一步提升分類準確率.

為了進一步提高腦功能連接的分類效果,本文提出基于原型學習與深度特征融合的腦功能連接分類方法.與CPM-Nets 不同的是,本文使用的數(shù)據(jù)為單一模態(tài),并不涉及模態(tài)缺失的情況;此外本文所提方法還探索了深度模型中不同層次的特征對分類性能的影響.具體來說,首先,利用SAE 提取腦功能連接中不同層次的特征;然后,使用原型學習在SAE 的每個隱層中提取表示樣本類別信息的距離特征;最后,利用提出的深度特征融合策略將提取到的距離特征融合,并將該融合特征用于類別標簽預測.在ABIDE 數(shù)據(jù)集上的實驗結(jié)果表明,本文所提方法不僅提升了腦功能連接的分類準確率,而且能夠根據(jù)模型提取到的鑒別性特征更加準確地定位與精神障礙疾病相關(guān)的腦區(qū).

1 相關(guān)工作

1.1 腦功能連接分類

腦功能連接分類是一種通過分析腦功能連接來判斷被試是否患有精神疾病的技術(shù),近年來得到了廣泛研究.Craddock 等[2]首次使用RFE-SVM 來對抑郁癥患者的腦功能連接分類,該方法首先使用遞歸式特征消除(Recursive feature elimination,RFE)算法選擇功能連接中對分類貢獻較大的特征,然后利用這些特征訓練SVM,能夠有效地區(qū)分正常對照(Typical controls,TC)和抑郁癥患者,目前已廣泛應用于腦功能連接分類任務.Khazaee 等[3]利用圖論構(gòu)建腦功能連接,經(jīng)過特征選擇后使用SVM作為分類器進行分類,可以有效地識別出輕度認知障礙(Mild cognitive impairment,MCI)和阿爾茲海默癥(Alzheimer's disease,AD).Wang 等[14]將SVM 用于青少年精神分裂癥(Schizophrenia,SZ)患者與TC 的腦功能連接分類任務,并通過學習到的權(quán)值識別出了與疾病相關(guān)的異常腦區(qū).Bi 等[15]指出單個SVM 容易受到核函數(shù),懲罰系數(shù)等因素的影響,因此提出了一種基于隨機SVM 的腦功能連接分類方法.該方法從訓練集中隨機選取部分樣本,經(jīng)過特征提取后用來訓練一個SVM 分類器,多次重復上述過程得到多個SVM 分類器,在測試時使用投票策略來預測樣本類別.此外,由于LASSO能夠獲得稀疏的特征表示,在腦功能連接的分類中的應用也較為廣泛.Watanabe 等[16]針對功能連接的結(jié)構(gòu)信息提出了一種正則化框架,使用LASSO對功能連接進行稀疏性約束,將稀疏化的功能連接特征作為SVM 的輸入來分類,提高了腦功能連接的分類效果.然而,這些淺層模型無法提取數(shù)據(jù)中深層次的特征,給算法的性能帶來了限制.

近年來,深度學習方法常被用來提取數(shù)據(jù)深層次的特征,提高了腦功能連接的分類準確率.Kim等[4]認為使用深度學習方法在功能連接中提取的高層次特征能夠提高分類效果,提出了一種帶有權(quán)重稀疏控制的SAE,通過L1正則化控制每個隱層權(quán)重的稀疏性.在精神分裂癥的分類任務中,誤差明顯低于SVM,此外,通過定量地分析各隱層的權(quán)重發(fā)現(xiàn),從高隱層中提取的特征表現(xiàn)出了SZ 組與TC 組之間腦功能連接整體性的差異.Li 等[5]提出了一種用于腦功能連接分類的遷移學習框架,首先使用SAE 學習TC 組的功能連接模式,然后將該模型用于自閉癥譜系障礙(Autism spectrum disorder,ASD)的分類任務,提高了神經(jīng)網(wǎng)絡在小數(shù)據(jù)集中的泛化能力.Anibal 等[17]使用含有兩個隱層的棧式去噪自編碼器(Stacked denoising autoencoders,SDAE)提取腦功能連接中低維度的特征,對1 035名被試(其中包含505 名ASD和530名TC)進行了分類,準確率達到了70 %.Ju 等[18]構(gòu)建了一個用來分類正常衰老和輕度認知障礙的SAE,相比于傳統(tǒng)機器學習方法,分類精度提高了31.32 %.除了SAE,基于CNN 的方法在腦功能連接分類中同樣應用廣泛.Parisot 等[19]提出了一種圖卷積神經(jīng)網(wǎng)絡(Graph convolution network,GCN)分類框架,他們將所有被試表示為一個稀疏的圖,圖的節(jié)點為腦功能連接,邊的權(quán)重通過性別,年齡等表型信息確定.該方法通過圖模型將腦功能連接與表型數(shù)據(jù)結(jié)合,取得了不錯的分類效果.Meszlényi 等[6]針對功能連接的特點,利用CNN 的多通道機制提出了Connectome-CNN (CCNN)模型,該模型能夠系統(tǒng)地整合功能連接中不同維度的特征,提高了分類準確率.Kawahara 等[7]提出了基于CNN 的Brain-NetCNN 框架,設計了邊到邊層,邊到節(jié)點層,節(jié)點到圖層三種不同的卷積層來提取腦功能連接不同層次的拓撲特征.Brown 等[20]進一步擴展了Brain-NetCNN 框架,利用數(shù)據(jù)驅(qū)動的大腦解剖結(jié)構(gòu)特性來對腦功能連接進行正則化.該方法不僅提高了分類準確率,還能根據(jù)學習到的網(wǎng)絡參數(shù)來分析對分類貢獻較大的特征.Xing 等[21]考慮到不同腦區(qū)對應的功能連接之間的獨立性,基于BrainNetCNN框架提出了一種帶有獨立卷積核的CNN.該模型賦予每條功能連接獨一無二的權(quán)重,更加真實地反映了腦功能連接中的拓撲結(jié)構(gòu)信息,因此能夠更加精確地識別異常腦區(qū).可見,基于深度學習的腦功能連接分類方法已成為一個前沿熱點.

1.2 原型學習

原型學習是模式識別領(lǐng)域中一種經(jīng)典的學習方法,主要思想是從數(shù)據(jù)中學習能夠很好地表示各類特征分布的原型,然后根據(jù)特征到原型的距離來分類.其中最著名的是K 最鄰近分類算法(K-nearestneighbor,KNN).為了提高KNN 的計算效率,Kohonen[22]提出了學習矢量量化(Learning vector quantization,LVQ),由于其結(jié)構(gòu)簡單,學習能力強,之后衍生出了許多改進版本,如LVQ2,LVQ3[23].按照原型更新的方式可以將原型學習分為兩大類:一類是通過人工設計的更新規(guī)則來更新原型,另一類是使用自定義損失函數(shù),通過參數(shù)優(yōu)化的方式來更新原型.其中基于參數(shù)優(yōu)化的學習方法由于靈活性高,應用更為廣泛.然而這些經(jīng)典的原型學習方法使用的是基于手工設計的淺層特征,給算法的性能帶來了限制.

最近,有研究嘗試將原型學習與深度學習結(jié)合,明顯提升了模型的分類準確率和魯棒性.Snell 等[24]提出了一種原型網(wǎng)絡,它能夠?qū)W習一個度量空間,在這個空間中通過計算特征到每個類的原型的距離來分類.該方法在小樣本學習領(lǐng)域取得了不錯的效果.Boney 等[25]進一步改進了原型網(wǎng)絡,通過添加自適應策略來識別新的類別,并將其應用于半監(jiān)督模式下的小樣本學習.Yang 等[11]將原型學習與卷積神經(jīng)網(wǎng)絡結(jié)合,提出了卷積原型學習,該模型在每個類別中學習多個原型,然后通過度量特征與原型的距離來進行類別預測.實驗表明,相比于傳統(tǒng)的CNN,該模型不僅在增量學習上有巨大優(yōu)勢,而且能夠獲得類內(nèi)差異小,類間差異大的鑒別性特征.Wang 等[12]提出了一種原型集成的方法,用于增量學習中新類別的檢測,該方法能夠縮小CNN 提取到的特征的類內(nèi)差異,擴大類間差異,從而提高了新類別的檢測的魯棒性.Zhang 等[13]假設不同模態(tài)的信息能夠由一個公共特征來表示,將多個模態(tài)的數(shù)據(jù)通過深度編碼映射為一個公共特征,然后使用非參數(shù)化分類器對該特征進行分類.該方法避免了參數(shù)化的分類器帶來的泛化能力下降的問題,并且分類結(jié)果具有較高的可解釋性,本質(zhì)上是多模態(tài)原型分類.因此,原型學習能夠進一步提升深度學習模型的特征提取能力,從而提升分類效果.

2 基于原型學習與深度特征融合的腦功能連接分類方法

2.1 基本思想和框架

原型學習使用特征空間中的一組原型來表示某個類別中特征的分布中心,通過度量特征到原型的距離來進行類別標簽預測.因此,我們將原型學習與SAE 結(jié)合,通過度量由SAE 提取的腦功能連接特征到原型的距離來表示功能連接所屬的類別,并且訓練過程中不斷減小特征到同類別原型的距離,擴大特征到不同類別原型的距離,從而提升SAE提取鑒別性特征的能力.

SAE 能夠通過一系列非線性變換從腦功能連接中提取從低層次到高層次的特征,其中低層次特征表達腦功能連接的局部信息,高層次特征表達腦功能連接的全局信息,在分類時綜合利用各層次特征有望進一步提升分類準確率.為此,本文提出深度特征融合策略,目的是在分類時充分利用不同層次的特征中,以此來提升模型的分類準確率.

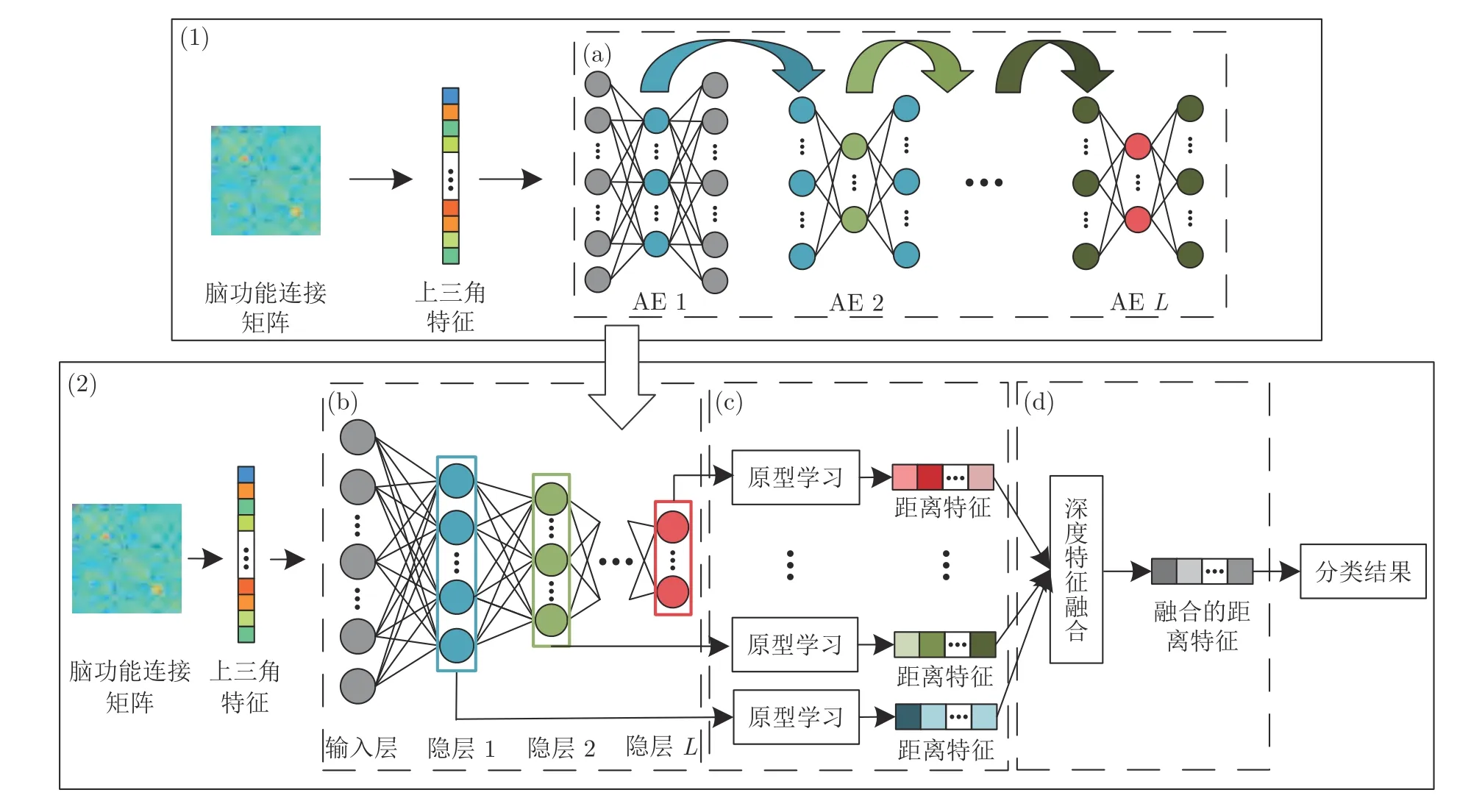

基于上述思想,本文提出了基于原型學習與深度特征融合的腦功能連接分類方法,整體框架如圖1所示.該分類模型主要由兩部分構(gòu)成:第一部分如實線框(1)所示,為自編碼器的無監(jiān)督預訓練;第二部分如實線框(2)所示,為整個模型的有監(jiān)督微調(diào).其中第二部分包含三個關(guān)鍵步驟:虛線框(b)所示的基于棧式自編碼器的逐層特征提取,用于提取腦功能連接中不同層次的特征;虛線框(c)所示的基于原型學習的距離特征提取,通過距離來表示抽象特征的類別信息;虛線框(d)所示的深度特征融合策略,該策略的目的是將各隱層的距離特征進行融合.最后使用融合后的特征來預測腦功能連接的類別標簽.

2.2 基于棧式自編碼器的逐層特征提取

為了提取腦功能連接中不同層次的特征,我們構(gòu)建了一個具有L個隱層的SAE.自編碼器是一個單隱層的全連接神經(jīng)網(wǎng)絡,通過重構(gòu)輸入來獲得隱層的特征表示.如圖1 (a)所示,無監(jiān)督預訓練L個自編碼器,訓練完成后按圖1 (b)將這些自編碼器堆疊起來,構(gòu)成一個具有L個隱層的SAE,使用這個SAE 來提取腦功能連接不同層次的特征.

圖1 基于原型學習與深度特征融合的腦功能連接分類方法結(jié)構(gòu)圖Fig.1 Architecture of brain functional connection classification based on prototype learning and deep feature fusion

在訓練第一個自編碼器時,將腦功能連接x ∈Rn×1作為輸入,n為特征維度,首先通過編碼器得到x的隱層特征,再由解碼器對該特征進行重構(gòu),通過最小化輸入與輸出之間的誤差來優(yōu)化網(wǎng)絡參數(shù).隱層特征的計算公式為:

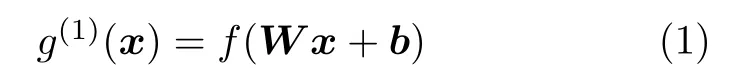

其中g(shù)(1)(x) 表示第一個自編碼器提取到的隱層特征,f(·) 為非線性激活函數(shù),W和b分別表示編碼器的權(quán)值和偏置.重構(gòu)輸出為:

其中W′和b′分別表示解碼器的權(quán)值和偏置.訓練階段的損失函數(shù)為:

上式第一部分為均方誤差,表示輸入與重構(gòu)輸出之間的差異,第二項為L1正則化項,目的是得到腦功能連接稀疏的隱層特征表示,α為正則化項的系數(shù).

當?shù)谝粋€自編碼器訓練完成后,將其隱層特征作為輸入來訓練第二個自編碼器,直到L個自編碼器全部訓練完成,然后將它們的編碼器部分堆疊起來構(gòu)建一個具有L個隱層的SAE.我們將SAE 作為特征提取器,第l個隱層提取到的特征記為g(l)(x),其中l(wèi)∈{1,2,···,L}.當l較小時提取到是表達局部信息的低層次特征,當l較大時提取到的是表達全局信息的高層次特征.

2.3 基于原型學習的距離特征提取

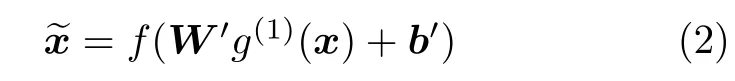

在本節(jié)中,我們在SAE 的每個隱層中,利用原型學習提取能夠表示腦功能連接類別信息的距離特征.距離特征是一個向量,其維數(shù)與數(shù)據(jù)類別的數(shù)量相同,各元素為隱層特征到對應類別中所有原型的最小距離.接下來介紹提取過程.

在第L個隱層中,首先使用在訓練集中提取的特征的平均值來初始化對應類別的原型,記為,其中c∈{1,2,···,C},C為類別數(shù)量,j ∈{1,2,···,K}表示第j個原型,K為每個類別中原型的數(shù)量.然后計算隱層特征到所有原型的歐氏距離,將各類別中距離的最小值表示為,計算公式如下:

最后將計算得到的隱層特征到各類別原型的最小距離組成一個向量,該向量即為距離特征.由于原型可以看作特征分布的中心,那么和原型類別相同的特征將會與原型之間具有較小的距離,和原型類別不同的特征與原型之間的距離會相對較大,所以越小,表示g(l)(x) 與的相似度越大,屬于同一類別的概率越大.因此,距離特征可以用來計算腦功能連接所屬類別的概率.

圖2 為在SAE 的第l個隱層空間中使用原型學習進行距離特征提取的示意圖,其中類別數(shù)量C=2,每個類中的原型數(shù)量K=2,可以看到隱層特征到類別標簽為1 的原型的最小距離為1.3,到類別標簽為2 的原型的最小距離為2.0,因此第l層中提取的距離特征D(l)=[1.3,2.0] .

圖2 基于原型學習的距離特征提取示意圖Fig.2 Illustration of the distance feature extraction based on prototype learning

2.4 深度特征融合

在SAE 的多層結(jié)構(gòu)中,從不同隱層中提取到的特征表達的信息不盡相同,其中從低隱層中提取的一般為表示腦功能連接局部信息的低層次特征,而從較高隱層中提取的是表示腦功能連接全局信息的高層次特征.為了在分類時綜合利用高層次和低層次特征中的類別信息,本文提出深度特征融合策略.該策略通過逐元素相加的方法將多個隱層中基于原型學習提取的距離特征融合,使用融合后的特征來預測腦功能連接的類別,充分利用了高層次特征和低層次特征中的類別信息,實現(xiàn)了信息互補,有利于提升分類準確率.下面介紹深度特征融合的具體實現(xiàn)過程.

首先使用上一節(jié)中介紹的方法在SAE 的每個隱層中提取一個距離特征,由于從不同的隱層中提取的特征所表達的信息有所差別,所以不同隱層中的距離特征所表示的類別信息也會有所差異;然后對所有距離特征進行歸一化操作,目的是消除數(shù)量級的差異,由于不同隱層神經(jīng)元數(shù)量有所差異,所以從不同隱層提取的距離特征的數(shù)量級也會不同,如果直接將距離特征融合,會造成很大的偏差;接著為每個隱層賦予一個權(quán)重系數(shù),將其與歸一化的距離特征相乘,該權(quán)重系數(shù)決定隱層特征對最終分類結(jié)果的貢獻程度,其值越大,表示對應隱層特征對分類結(jié)果的影響越大;最后將所有歸一化與加權(quán)后的距離特征逐元素相加,即為融合后的距離特征.具體計算公式如下:

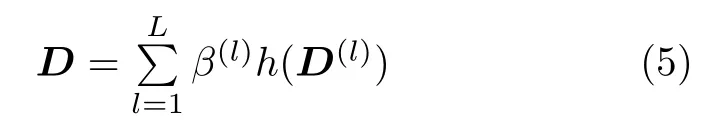

其中D=[d1,d2,···,dC] 表示融合后的距離特征.β(l) 表示第l層的權(quán)重系數(shù),通過驗證集在各隱層的準確率的比值來確定,既考慮了不同隱層對最終分類結(jié)果的影響,又避免了人為設置帶來的偏差,并且.此外,當指定β(l)=0 時,表示第l層的距離特征不參與融合,因此可以靈活地控制特征的融合方式.h(·) 為歸一化函數(shù).

2.5 分類模型

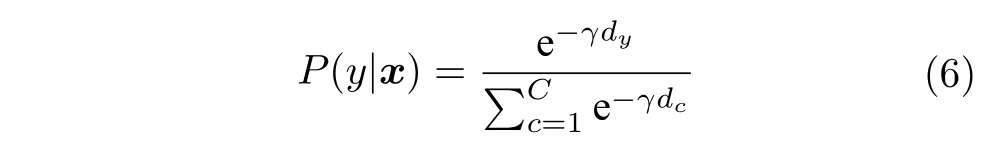

在本文中,我們使用融合后的距離特征來預測功能連接的類別,相當于綜合考慮了各隱層特征對分類的貢獻.因此,x屬于類別y的概率可以表示為:

其中γ為控制概率賦值的超參數(shù),由于特征到原型的距離越近,屬于同一類別的概率越大,因此需要取反.

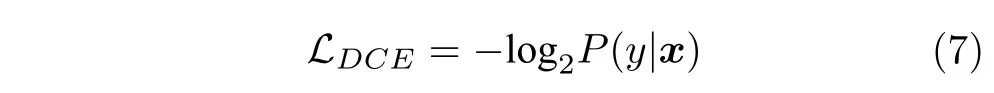

我們的目標是學習一個能夠提取鑒別性特征并且具有較高分類準確率的深度神經(jīng)網(wǎng)絡,因此,設計合適的損失函數(shù)至關(guān)重要.基于上式,我們可以使用基于距離的交叉熵損失(Distance based cross entropy loss,DCE loss)來計算分類誤差,公式如下:

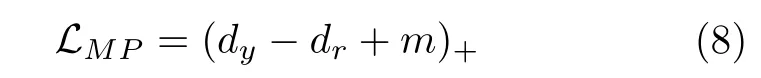

最小化DCE loss 相當于減小各隱層特征到對應原型的距離,所以能夠?qū)W習到類內(nèi)差異較小的特征.然而,訓練過程中僅靠DCE loss 有過擬合的風險.因此,我們在損失函數(shù)中加入了基于間隔的原型損失(Margin based prototype loss,MP loss)作為正則化項,在訓練過程中減小各隱層特征到對應類別原型之間距離的同時,擴大到不同類別原型之間的距離.假設從腦功能連接x提取的融合距離特征中,dy和dr分別表示到相同類別原型的距離和到不同類別原型的最小距離,那么當樣本分類正確時,有dy<dr,此時我們認為正則化項應該為零;當樣本分類錯誤時,有dy>dr,這種情況下我們認為正則化項應該大于零.為了進一步地提升模型的泛化能力,我們在損失函數(shù)中加入間隔超參數(shù),因此基于間隔的原型損失定義為:

其中m∈(0,1) 為間隔超參數(shù).即使樣本分類正確,也會對模型施加懲罰,從而提高模型的泛化能力.由于原型是可訓練的,所以最小化MP loss 意味著縮小特征到同類別原型間的距離,擴大到不同類別原型之間的距離.那么在SAE 的各隱層中,不同類別的隱層特征將具有更大的類間差異.最后,將DCE loss和MP loss 聯(lián)合起來訓練SAE,整體損失函數(shù)為:

其中,λ是正則化項的系數(shù).

2.6 算法描述

基于原型學習與深度特征融合的腦功能連接分類方法的訓練過程如算法1 所示.

算法1.基于原型學習與深度特征融合的腦功能連接分類方法

Output:SAE 的網(wǎng)絡參數(shù)和所有原型.

算法1 通過無監(jiān)督預訓練的方式初始化SAE的網(wǎng)絡參數(shù),能夠使各隱層中的原型在初始化時就具有較好的代表性.在訓練模型時,使用的是有監(jiān)督的方法,在縮小特征到同類別原型之間距離的同時,擴大到不同類別原型之間的距離,因此能夠提取到類內(nèi)差異小,類間差異大的鑒別性特征.

3 實驗結(jié)果與分析

3.1 實驗數(shù)據(jù)與預處理

本研究使用ABIDE 數(shù)據(jù)集來驗證所提方法的有效性.該數(shù)據(jù)集共享來自世界各地的自閉癥腦影像數(shù)據(jù),旨在通過大規(guī)模數(shù)據(jù)加快對自閉癥神經(jīng)基礎(chǔ)的理解.其中包含來自17 個不同站點的1 112 名被試的rs-fMRI 數(shù)據(jù).由于77 名被試的數(shù)據(jù)異常,經(jīng)篩選后,使用剩余1 035 名被試的腦功能連接作為實驗數(shù)據(jù),其中TC 組530 人,ASD 組505 人.

預處理過程如下.首先,本文采用Preprocessed connectomes project (PCP)提供的Configurable pipeline for the analysis of connectomes(CPAC)預處理流程,包括層間時間校正,頭動校正,全局平均強度歸一化,干擾信號回歸,帶通濾波和空間配準等.然后,使用Craddock 等[26]提出的CC200 模板來識別大腦皮層中的感興趣區(qū)域(Region of interest,ROI).該模板將大腦皮層劃分為200 個空間相近,功能活動相關(guān)的區(qū)域.從預處理的rs-fMRI 中提取各個ROI 的平均時間序列.接著,利用各個ROI 的平均時間序列計算每對ROI之間的皮爾遜相關(guān)系數(shù)(Pearson correlation coefficient,PCC),通過Fisher's z 變換將得到的相關(guān)系數(shù)歸一化,得到每個被試的功能連接矩陣,大小為200×200,其中每個元素表示一對ROI 之間的連接強度.最后,選取功能連接矩陣的上三角,將其展開為一維向量作為模型的輸入,該一維向量的維數(shù)計算公式如下:

其中N為ROI 的數(shù)量,S為一維向量的維數(shù),本研究中N=200,因此S=19 900 .

3.2 實驗設置和評價指標

在大多數(shù)文獻中,SAE 的隱層節(jié)點數(shù)量通常是根據(jù)經(jīng)驗設置的.如果隱層節(jié)點數(shù)量太多,會增加訓練時間,如果數(shù)量太少,可能無法充分提取有價值的特征,出現(xiàn)欠擬合的現(xiàn)象.在本文中,我們將第一個隱層的節(jié)點數(shù)量設置為1 000,其余隱層節(jié)點數(shù)量設置為100,實驗中所有SAE 均按此設置構(gòu)建.訓練時使用Adam 梯度下降算法最小化損失函數(shù),每次迭代的批大小為96,更新參數(shù)時學習率的大小為 1×10-4.所有實驗的訓練集,驗證集,測試集的劃分比例為3:1:1,并根據(jù)該劃分循環(huán),使得每一折都作為測試數(shù)據(jù)對實驗性能進行評估.上述過程重復運行十次后取實驗結(jié)果的平均值來驗證所提方法的有效性.

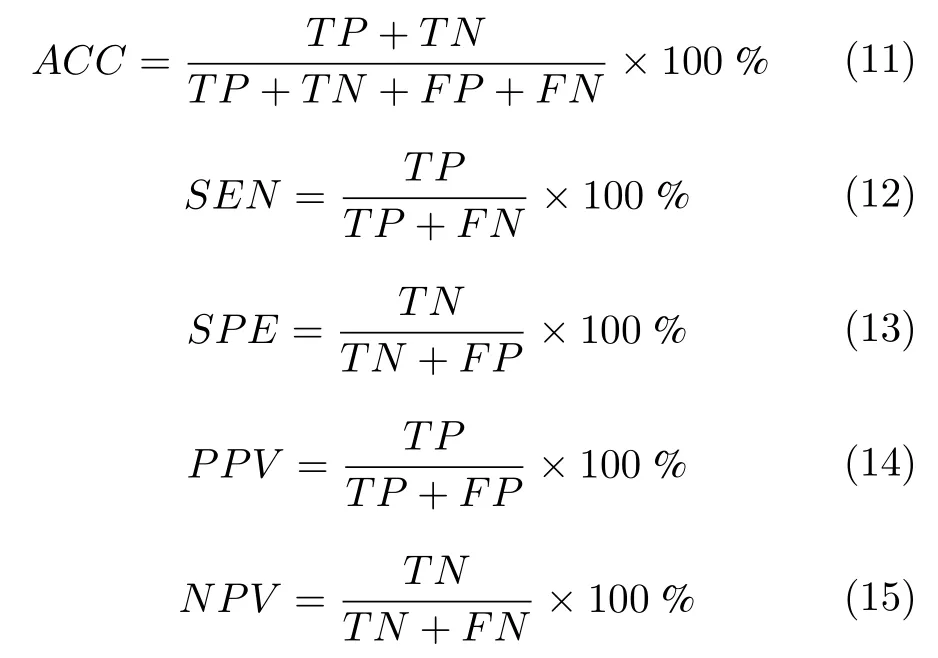

實驗采用目前廣泛使用的準確率(Accuracy,ACC),靈敏度(Sensitivity,SEN),特異度(Specificity,SPE),正預測率(Positive predictive value,PPV)和負預測率(Negative predictive value,NPV)五種指標評價模型的分類性能.五種指標的計算公式如下:

其中,TP表示實際標簽為正,預測標簽為正的樣本數(shù)量;TN表示實際標簽為負,預測標簽為負的樣本數(shù)量;FP表示實際標簽為負,預測標簽為正的樣本數(shù)量;FN表示實際標簽為正,預測標簽為負的樣本數(shù)量.

3.3 不同實驗策略對分類性能的影響

3.3.1 隱層數(shù)量對分類性能的影響

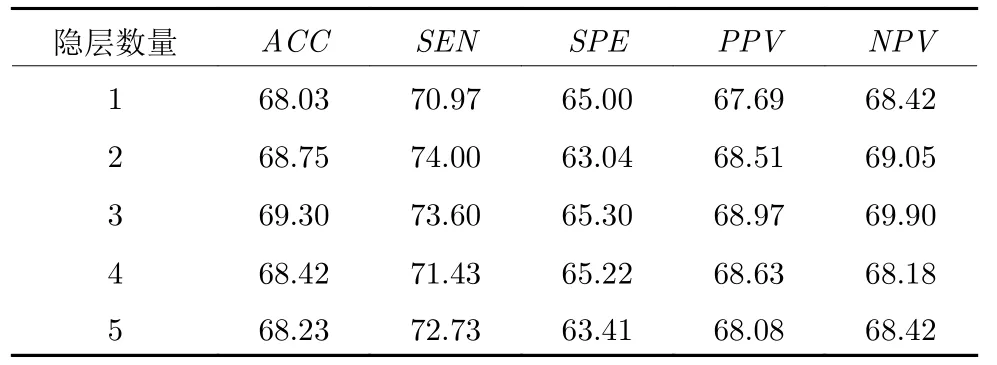

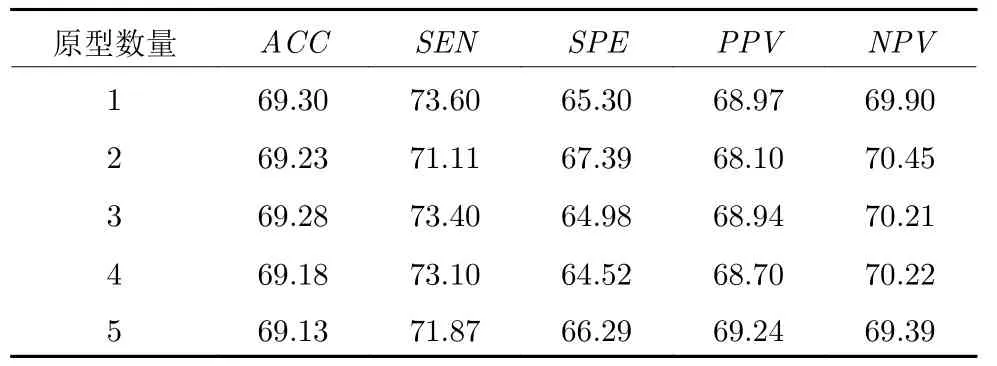

在本節(jié),為了確定結(jié)合原型學習的SAE (SAEPL)中的隱層數(shù)量L,我們構(gòu)建了多個具有不同隱層數(shù)量的SAE-PL,為了便于比較,我們在最后一個隱層中固定每個類別中的原型數(shù)量K=1,使用本文提出的損失函數(shù)訓練模型,除隱層數(shù)量外,其余超參數(shù)設置相同.表1 給出了不同隱層數(shù)量下SAE-PL 的實驗結(jié)果.

表1 不同隱層數(shù)量下的實驗結(jié)果(%)Table 1 Experimental results of our method with different hidden layers (%)

從表1 中可以看到,當L=1 時,分類準確率最低,原因是隱層數(shù)量太少,無法充分提取腦功能連接中的深層次特征.隨著隱層數(shù)量增加,分類準確率逐漸上升,當L=3 時分類準確率最高,達到了69.30 %,并且在SPE,PPV,NPV三個指標上均達到了最高值.而隨著隱層數(shù)量繼續(xù)增加,出現(xiàn)了分類性能下降的現(xiàn)象,其原因是腦功能連接的數(shù)據(jù)量較少,當網(wǎng)絡結(jié)構(gòu)復雜時,會出現(xiàn)過擬合的現(xiàn)象,從而影響分類效果.因此,在后續(xù)實驗中我們選擇具有3 個隱層的SAE-PL 作為基本結(jié)構(gòu).

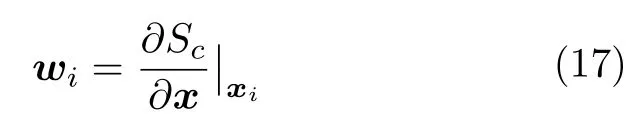

3.3.2 原型數(shù)量對分類性能的影響

在本節(jié)中,我們使用上一節(jié)中確定的網(wǎng)絡結(jié)構(gòu),在SAE-PL 的最后一個隱層中利用原型學習分別在ASD 組和TC 組中學習一組代表性的原型.為了測試SAE-PL 中原型數(shù)量K對實驗結(jié)果的影響,我們分別取不同的K值進行了實驗.除了原型數(shù)量外,其余超參數(shù)設置相同,結(jié)果如表2 所示.

表2 不同原型數(shù)量下的實驗結(jié)果(%)Table 2 Experimental results of our method with different number of prototypes (%)

從表中可以看到,K=1 時取得了最高的ACC和SEN.對于不同的K值,實驗結(jié)果差異并不明顯,在每個類別中設置多個原型并沒有帶來分類準確率的提升.其主要原因是SAE-PL 具有強大的特征提取能力,在每個類別中使用單個原型就能夠較好地表示特征的分布,所以引入多個原型并不會提高分類性能.而當數(shù)據(jù)的類內(nèi)分布較為復雜時,使用多個原型可能會得到更好的結(jié)果.因此,在后續(xù)實驗中使用的原型數(shù)量K均為1.

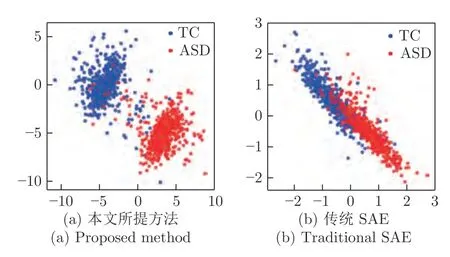

3.4 原型學習對特征分布的影響

為了探究原型學習對特征分布的影響,我們還基于最常用的softmax 損失函數(shù)訓練了一個沒有結(jié)合原型學習的傳統(tǒng)SAE,然后利用Wen 等[27]提出的toy model 分別將SAE和SAE-PL 中最后一個隱層提取到的特征投影到二維空間中,對其進行可視化,結(jié)果如圖3 所示.圖3 (a)是本文所提方法提取到的特征的分布情況,圖3 (b)為傳統(tǒng)SAE 提取到的特征分布情況.從圖中可以看出,傳統(tǒng)SAE 提取的特征類內(nèi)差異較大,類間差異較小,而SAEPL 提取到的特征類內(nèi)差異明顯更小,類間差異更大,因此SAE-PL 能夠提取到具有鑒別性的特征.

圖3 兩種方法的特征分布對比Fig.3 Comparison of the two methods'feature distribution

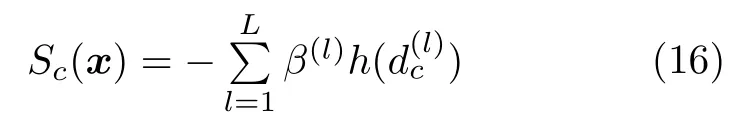

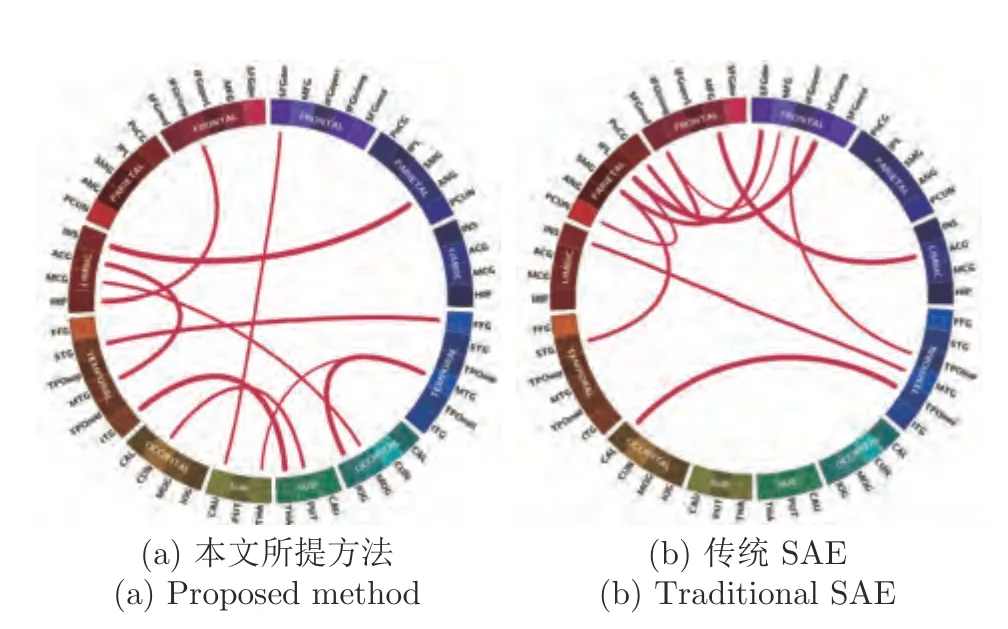

此外,我們還進一步探索了根據(jù)SAE和SAEPL 提取到的特征識別出的異常腦區(qū)的差異.具體地,使用Simonyan 等[28]提出的特征排序方法定義一個類評分函數(shù):

給定一個功能連接數(shù)據(jù)xi和其類別,使用向量wi表示xi中各元素的重要程度,wi的計算方式為:

模型訓練完成后固定網(wǎng)絡參數(shù),由式(17)根據(jù)鏈式求導法則計算測試集中每個功能連接對分類貢獻的權(quán)值,權(quán)值的絕對值越大表示對分類結(jié)果的貢獻越高.然后將測試集中所有數(shù)據(jù)計算得到的權(quán)值的絕對值相加,得到每個功能連接最終的分類貢獻.最后按取前十個貢獻最大的連接,這些連接對應的腦區(qū)即為與疾病相關(guān)的異常腦區(qū).圖4 分別展示了由兩種方法提取的特征分析得到的前10 個重要連接,每條線的粗細表示對分類任務的貢獻程度,較粗的線表示貢獻較大.值得注意的是,由SAE-PL提取的特征分析得到的梭狀回(FFG),丘腦(THA),海馬(HIP)等異常腦區(qū)在其他研究[6,17]中被證實與ASD 相關(guān),而通過SAE 得到的異常腦區(qū)中卻沒有涉及.因此,SAE-PL 提取的鑒別性特征能夠更加準確地定位與疾病相關(guān)的異常腦區(qū).

圖4 兩種方法得到的前十個重要連接Fig.4 Top ten important connections learned by two methods

3.5 深度特征融合對分類性能的影響

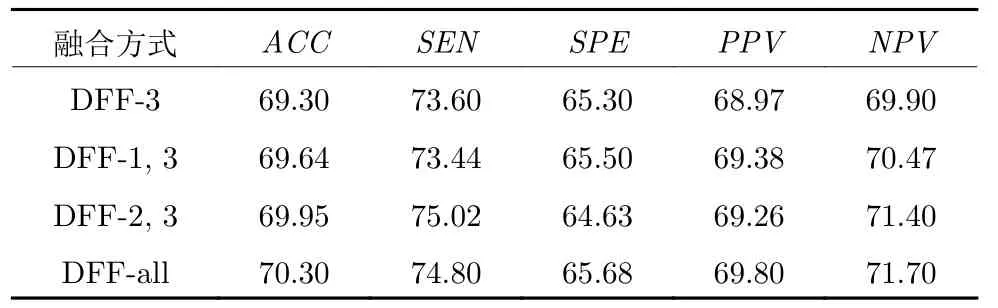

本節(jié)測試了深度特征融合策略對實驗結(jié)果的影響.我們使用式(5)將SAE-PL 的不同隱層中由原型學習提取的距離特征融合.通過將第l層的加權(quán)系數(shù)置零來控制特征融合的方式,最后使用融合后的特征來分類.其中DFF-3 對應的β(1)=0,β(2)=0,表示僅使用最后一個隱層中的距離特征分類,DFF-1,3 對應的β(2)=0,表示融合第一層和第三層中的距離特征,DFF-2,3 對應的β(1)=0,表示融合第二層和第三層中的距離特征,DFF-all 表示融合所有隱層中的距離特征.實驗結(jié)果如表3 所示.

由表3 可以看出,DFF-3 的ACC最低,這是因為在分類時僅使用了高層次的特征,沒有充分利用SAE 提取到的各層次的特征.而DFF-1,3和DFF-2,3 融合了低隱層中的距離特征,ACC和其他各項指標均有所提升.DFF-all (下文記為SAE-PLDFF) 在分類時使用融合全部隱層中的距離特征ACC指標達到了最高的70.30 %,并且在SPE,PPV和NPV三個指標上均取得了最高值,說明綜合考慮高層次特征和低層次特征有利于提升分類性能,有效的驗證了深度特征融合的有效性.

表3 不同深度特征融合方式下的實驗結(jié)果(%)Table 3 Experimental results of our method with different deep feature fusion modes (%)

3.6 算法的收斂性

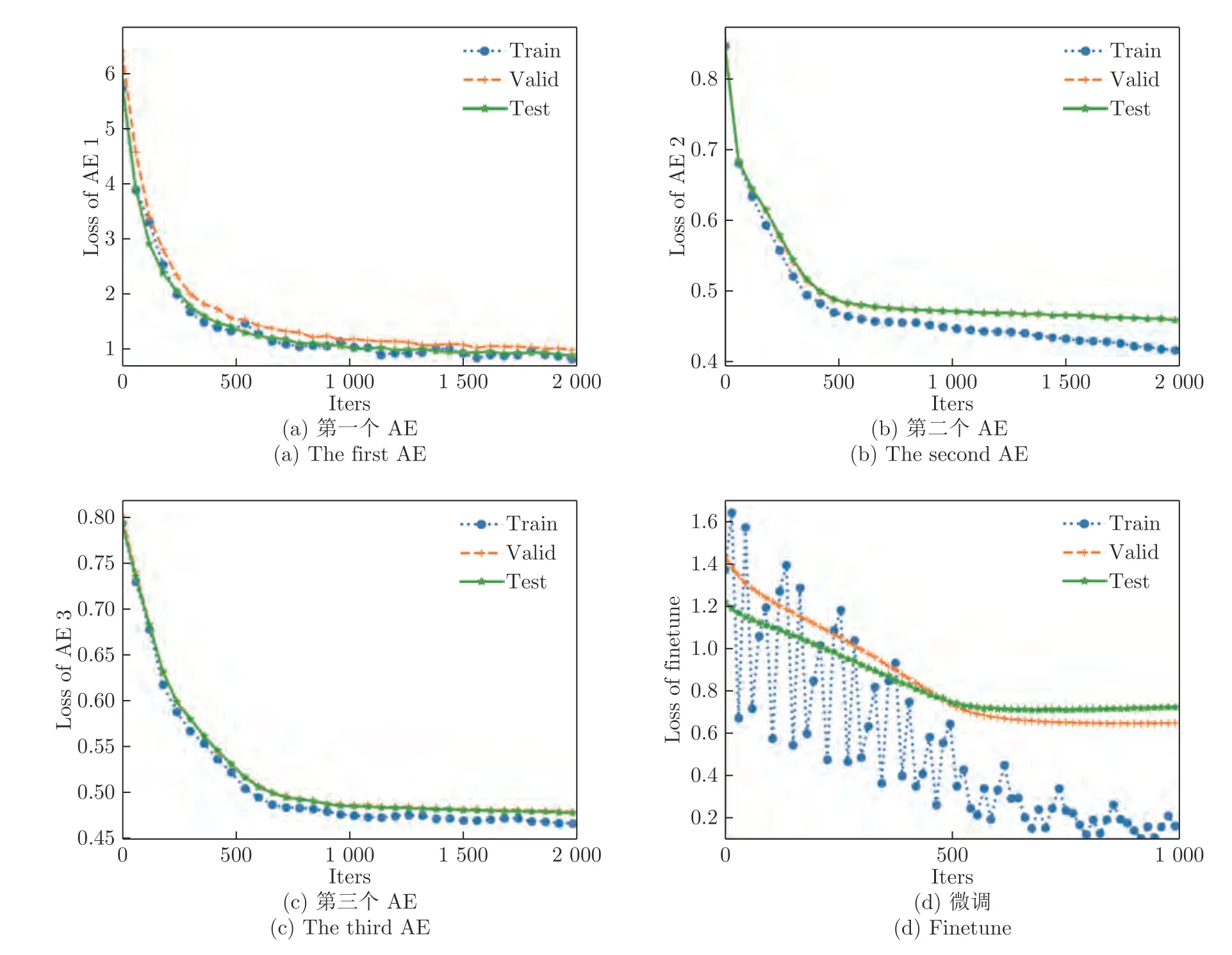

為了直觀地展示本文所提算法的收斂性,我們繪制了無監(jiān)督預訓練和有監(jiān)督微調(diào)兩個階段的Loss 曲線,如圖5 所示.

在預訓練階段,由圖5 (a),(b),(c) 所示的Loss 曲線可以看出,整體的收斂效果較好,當驗證集Loss 最低時,保存網(wǎng)絡參數(shù)用于后續(xù)的訓練;在微調(diào)階段,訓練集的Loss 雖略有抖動,但整體呈下降趨勢,驗證集和測試集的Loss 也隨迭代次數(shù)的增加整體下降,最終保存驗證集Loss 最低時的網(wǎng)絡參數(shù)用于測試.綜上,算法1 是收斂的.

圖5 算法1 的訓練曲線Fig.5 Train plot of the algorithm 1

3.7 與多種經(jīng)典算法的對比實驗

為了驗證本文所提方法相比于其他方法的優(yōu)劣,我們分別從傳統(tǒng)的機器學習方法和深度學習方法中選取了六種經(jīng)典算法進行對比實驗.其中基于傳統(tǒng)機器學習的方法包括RFE-SVM[2]和LASSO[29],基于深度學習的方法包括BrainNetCNN[7],CCNN[6],SDAE[17]和GCN[19].結(jié)果如圖6 所示.

圖6 七種方法的分類性能對比Fig.6 Performance comparison of the seven methods

從圖中的實驗結(jié)果可以看出,本文所提方法SAE-PL-DFF 在各項指標上均達到最優(yōu),分類效果明顯優(yōu)于其他算法.在這七種方法中,基于深度學習的方法明顯優(yōu)于基于傳統(tǒng)機器學習的方法.基于傳統(tǒng)機器學習的算法ACC指標均低于65 %,這是由于傳統(tǒng)機器學習模型為淺層模型,無法充分挖掘腦功能連接中有價值的深層信息,而基于深度學習的方法ACC指標均在65 %以上,體現(xiàn)了深度學習方法處理高維的腦功能連接上的優(yōu)勢.對比其他4種基于深度學習的方法,SAE-PL-DFF 明顯優(yōu)于BrainNetCNN,CCNN,GCN和SDAE (p<0.05),ACC指標達到了70.3 %,其余各項指標的優(yōu)勢也相當明顯,其原因主要在于兩個方面:1)原型學習能夠輔助SAE 提取到類內(nèi)差異小,類間差異大的鑒別性特征,提高了模型的判別能力;2)本文所提方法融合了深度模型提取的低層次特征和高層次特征,實現(xiàn)了腦功能連接局部信息和全局信息的互補,進一步提升了分類準確率.上述結(jié)果驗證了本文所提方法的有效性.

4 結(jié)論

本文提出了一種基于原型學習與深度特征融合的腦功能連接分類方法.該方法使用棧式自編碼器提取腦功能連接中從低層次到高層次的特征,然后利用原型學習提取表示類別信息的距離特征,最后利用提出的深度特征融合策略將這些距離特征融合,使用融合后的特征來對腦功能連接分類.相關(guān)實驗表明,所提方法能夠有效地提取并利用不同層次的鑒別性特征,進一步提升了腦功能連接的分類準確率.值得一提的是,盡管我們只在腦功能連接數(shù)據(jù)上進行了實驗,但是所提方法是通用的,也可以應用于其他分類任務.

下一步的工作將進一步擴展本文所提方法,使用不同類型的模板來構(gòu)建不同視角的腦功能連接,將多視角深度學習方法用于腦功能連接分類,試圖綜合利用多個視角中的有效信息,進一步提升腦功能連接的分類效果.